Crédito, Arquivo pessoal

- Author, Luiz Fernando Toledo

- Role, Da BBC News Brasil em Londres

O economista Everton Freire, de 33 anos, já tinha preenchido algumas dezenas de formulários em busca de um novo emprego quando finalmente recebeu um e-mail positivo.

Foi classificado para a segunda etapa de um processo seletivo em uma empresa de educação do segmento da saúde.

Ele se surpreendeu ao descobrir que, nesta fase, seria entrevistado por uma inteligência artificial (IA), algo que nenhuma outra vaga que aplicou havia apresentado até então.

Aos poucos, esse tipo de tecnologia vem sendo implementado em processos seletivos de diversas empresas brasileiras, de diferentes portes.

As instruções para a conversa com a IA foram enviadas em texto, por Whatsapp, e as respostas dele deveriam ser dadas em áudio na mesma plataforma.

O programa do outro lado respondia rapidamente, mais até do que um humano faria, e direcionava as perguntas conforme as respostas dadas por Freire, aprofundando o assunto a cada novo questionamento.

Foram três ou quatro interações e o processo terminou. A resposta veio na hora e era positiva: ele se encaixava no perfil da vaga.

“Só que parou por aí. Nunca fui chamado para nenhuma outra etapa”, ele contou à BBC News Brasil.

Freire lembra que sentiu um misto de estranhamento e curiosidade com a experiência.

“A primeira emoção foi de resistência, por não estar falando com uma pessoa. Ainda mais por ser uma empresa que forma pessoas do ramo da saúde, mas que faz o processo de forma tão fria. Depois, pensei também que meu tempo foi otimizado e ao menos tive algum feedback. Talvez só não tenha sido tão bem ranqueado pela IA como outros candidatos.”

Hoje, já empregado em outra companhia, Freire avalia que esse tipo de tecnologia pode representar um ganho para as empresas, mas não necessariamente para o candidato.

“Para quem está buscando recolocação, quem está desempregado, é algo que desumaniza. Estar em uma segunda fase, lidando com uma IA, em uma coisa pré-programada, de dizer se estou apto ou não. Não foi tão positivo para mim.”

Crédito, Starmind/Reprodução

Por que empresas estão usando IA em entrevistas?

O uso de inteligência artificial em processos seletivos não é algo recente, mas ganhou novo impulso com a popularização da IA generativa, como os modelos de linguagem que sustentam o ChatGPT.

“O motivo que levou as empresas a implementar é o grande volume de aplicações, causado por ferramentas de recrutamento e plataformas como Linkedin, que fizeram com que pessoas de diferentes lugares pudessem aplicar. Era preciso controlar esse volume e agilizar o recrutamento”, diz Humberta Silva, que é professora da Hochschule Bremen, na Alemanha, e doutora em administração pela FEA-USP.

A especialista diz que a pandemia impulsionou ainda mais essa guinada tecnológica. E que empresas passaram então a experimentar ferramentas como chatbots, avaliação de entrevistas automatizada e rankings.

“A IA vai ter um impacto nas organizações ainda maior do que a internet teve no início dos anos 2000”, avalia o empresário e professor do Insper Edison Audi Kalaf, que diz ser um defensor da tecnologia.

“Tem muitas vantagens no uso da IA para recrutamento e seleção. Escalabilidade, padronização, redução de viés. Muitas vezes o recrutador tem vieses que vêm da criação dele, da formação, etc., que uma ferramenta bem treinada e utilizada pode não ter.”

O sucesso da tecnologia, avalia o professor, dependerá de como for usada.

“A tecnologia nuclear é extremamente útil. Mas você pode usar para fazer uma máquina que descobre um câncer ou para fazer uma bomba.”

A BBC News Brasil entrevistou representantes de quatro startups brasileiras que oferecem esse tipo de serviço específico de análise de entrevistas, todas com poucos anos (ou meses) de vida, mas que já incluem em seus portfolios empresas com milhares de funcionários.

Também testamos ferramentas do mercado (mais detalhes abaixo), tanto no papel de recrutador quanto de candidato.

O discurso que apresentam a favor das entrevistas automatizadas é semelhante: redução de custos, otimização de tempo e satisfação no processo, tanto para clientes quanto para os próprios candidatos.

“Um processo seletivo pode ter dez candidatos ou 1 mil. É humanamente impossível fazer tantas análises em tempo hábil, ainda mais quando empresas exigem prazos cada vez mais curtos por causa de rotatividade. Imagine se pudéssemos ter um recrutador pra cada candidato”, diz Patrick Gouy, CEO da Recrut.AI.

“Por isso o apelo para as empresas é tão grande, mas não só elas serão beneficiadas. Imagine o candidato ter acesso direto a uma IA que pudesse qualificar ele na hora, dar uma resposta mais rápida”, diz o empresário.

A tecnologia costuma ser aplicada em fases iniciais do processo, com grande volume de currículos, e não deve substituir a entrevista presencial para uma decisão final.

“É um caminho sem volta”, diz Christian Pedrosa, fundador e CEO da DigAI.

“Há uma agenda finita para avaliar candidatos. Isso força o recrutador a olhar para seus próprios vieses. Um exemplo: priorizar candidatos que fizeram intercâmbio, mesmo para uma vaga na qual a pessoa nem precisa falar inglês”, diz. “Do outro lado, há também quem usa ChatGPT para exagerar o currículo. A IA muda isso, porque a todo mundo é dada uma chance de mostrar se sabe do que está falando ou não.”

Augusto Salomon, CEO da Starmind, que também oferece esse tipo de tecnologia, avalia que a entrevista por IA julga menos do que um entrevistador humano.

“Você parte de um cenário com uma avaliação muito mais rica e sem julgamento, porque a IA não julga se a pessoa tem tal religião, tal aparência. Ela faz uma entrevista técnica com todo mundo e entrega dados de valor para o recrutador tomar a decisão.”

Pamela Borges, CEO da startup Coploy, reconhece haver receio das empresas em aderir a esse tipo de plataforma. E cita o medo de que profissionais de recrutamento sejam substituídos. “Eu costumo dizer que esse medo tem um remédio, que é a curiosidade, a vontade de conhecer o que está chegando no mercado.”

Ela avalia que a IA não substitui pessoas no processo de recrutamento, mas “devolve a humanidade ao ser humano, que faz trabalhos repetitivos e, às vezes, sem estratégia. A gente potencializa a capacidade daquele ser humano, deixando de lado tarefas que não trazem valor agregado, para provar o valor de seu trabalho.”

Quais são as consequências do uso de IA em entrevistas de emprego?

A tese de doutorado de Humberta Silva, defendida neste ano na FEA-USP, investigou os usos e consequências do uso da IA em processos seletivos. Concluiu que as vantagens, como agilizar e padronizar processos, não superam as consequências indesejadas. E citou algumas delas:

– Esperam que o candidato saiba usar termos e palavras-chave específicas; em nosso teste, por exemplo, uma das entrevistas deu foco exagerado a um termo técnico que não era o ponto mais importante da entrevista (mais detalhes abaixo)

– Há expectativa de que candidatos tenham acesso à internet e que preencham currículos de formas muito específicas para ter destaque; a necessidade de menção explícita a termos técnicos usados nas descrições das vagas, por exemplo, é citada por especialistas como uma forma de ser bem avaliado;

– Muitas empresas não informam que IA é usada em processo de seleção, enquanto especialistas dizem que é preciso divulgar, por questão de transparência;

“Estamos vendo muitas empresas adotando a tecnologia, mas sem entender como ela funciona. E isso traz riscos. Precisamos, como sociedade, entender que o acesso ao mercado de trabalho é a oportunidade para um indivíduo se tornar cidadão. Se criamos barreiras pela tecnologia, que tipo de sociedade a gente espera?”, avalia Silva.

Outro desafio, diz, é um maior desequilíbrio de poder.

“As empresas têm muito mais acesso às informações do candidato do que o candidato das empresas. E cria uma atmosfera de que o candidato precisa superar a IA para poder ser contratado. Quando o candidato não é aprovado, mesmo tendo todos os requisitos da vaga, percebe o algoritmo como inefetivo. As empresas deveriam balancear se as expectativas estão sendo atendidas e também a expectativa do candidato que querem atrair.”

As startups que oferecem o serviço de entrevista por IA apresentam dados que dizem que a maioria dos entrevistados aprova o processo seletivo. Nos testes feitos pela BBC News Brasil nessas ferramentas, tal avaliação era feita ao final da entrevista, na mesma plataforma.

A professora da FEA-USP Liliana Vasconcellos, que orientou a pesquisa de Silva, questiona esse método de avaliação.

“É uma pesquisa bem parcial, de responder no final sem saber se a informação vai ser usada pela empresa. O candidato pode achar que vai ser caracterizado como alguém que é contra a tecnologia.”

Outro estudo sobre o tema, um artigo publicado em 2023 por Daniel Blumen e Vanessa Cepellos na revista Cadernos Ebape, da FGV, se baseou em entrevistas com 12 recrutadores do setor farmacêutico.

Os entrevistados disseram que a IA pode ajudar a tornar o recrutador mais eficiente, em um papel mais consultivo do que operacional. Mas reconheceram que a ferramenta pode acabar excluindo determinados perfis de candidatos, que a tecnologia poderia não trazer as pessoas certas e perder talentos.

“Os algoritmos acontecem pela aprendizagem a partir do ser humano. Se estamos colocando dados que são discriminatórios, a máquina também vai atuar dessa maneira. As empresas ainda estão entendendo como fazer uso disso, como usar de uma forma ética,” diz Cepellos, uma das autoras da pesquisa e professora de gestão de pessoas e de carreiras da FGV.

“A questão é de como a ferramenta vai ser utilizada. A tecnologia é uma ferramenta, ela não vai ser utilizada em todas as etapas. É importante que o processo não perca a humanização.”

Crédito, Arquivo pessoal

A BBC News Brasil testou três plataformas que oferecem o serviço, nos papéis de recrutador e de candidato.

A primeira etapa do processo para o recrutador é a criação da vaga.

Ao definir um nome (por exemplo: “jornalista júnior”, um dos cargos que usamos em nossos testes), a própria inteligência artificial sugere uma descrição de perfil e requerimentos, que depois podem ser alterados pelo recrutador.

O jornalista júnior “será responsável por elaborar conteúdos jornalísticos escritos, com foco em clareza, apuração rigorosa e adequação ao público alvo”, descreveu uma das plataformas.

Em uma das ferramentas as perguntas eram as mesmas para todos os candidatos, pré-definidas pelo recrutador, e a entrevista requeria uso de câmera.

Em outra, os questionamentos pareciam se adaptar de acordo com as respostas fornecidas, tentando usar o que o candidato disse para aprofundar ou avançar em algum tema.

O candidato que aplica a alguma dessas vagas recebe um e-mail com o link para participar do processo, que pode ser feito por Whatsapp ou algum site. A depender da plataforma, pode ou não ser necessário ligar a câmera, ou usar o microfone e um chat por texto.

Por fim, os resultados chegam ao recrutador em um painel, em forma de ranking, e é possível ver a gravação da entrevista e como a IA avaliou cada resposta.

É possível definir se os candidatos receberão ou não uma resposta no fim do processo. Mas essa resposta não indica se ele foi aprovado ou não. A decisão caberá ao recrutador humano.

Robôs dão ênfase a palavras-chave e explicação de conceitos

Um elemento que se destacou em um dos testes é que o recrutador de IA deu ênfase exagerada a algumas palavras-chave que estavam na descrição da vaga. Não citar essa palavra ou não dar exemplos parece ter sido o motivo de redução da nota.

Um exemplo: apesar de ser uma vaga júnior, cuja descrição dizia que era “desejável ter noções básicas de SEO” (técnicas para que um texto tenha mais destaque nas buscas online)“, o termo foi citado diversas vezes na avaliação, quase sempre em contexto crítico.

Na prática, era como se esperasse que o candidato dominasse o tema. Na avaliação de uma das respostas, por exemplo, a IA chegou a dizer que o entrevistado “precisa desenvolver melhor a estruturação e análise de desempenho de conteúdo para atender às expectativas do cargo”.

Na ferramenta com perguntas pré-programadas, a IA também ignorou habilidades não previstas na vaga e citadas pelo candidato, mas que também se encaixavam nos requisitos.

Houve ainda casos em que a crítica para reduzir uma nota não tinha relação com o que foi perguntado. Um exemplo: o entrevistador questiona se o candidato já teve de escrever sobre um assunto fora de sua zona de conforto. Depois, avalia que o candidato “deve aprimorar conhecimentos em SEO e dados”.

Em um dos testes notamos também que a IA demandava do candidato explicações mais conceituais de questões práticas.

Ao questionar sobre quais fontes costuma utilizar na cobertura de economia, e receber como resposta menções a instituições como IBGE e Banco Central, a ferramenta diz que ele “não detalhou seis critérios de noticiabilidade típicos em economia”, e atribuiu nota 2/6.

E se o candidato também usar IA pra responder?

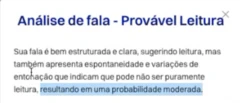

Uma das descobertas mais curiosas do teste foi que algumas empresas orientam os candidatos a não usar inteligência artificial nas respostas, sob o argumento de que conseguem detectar esse tipo de uso.

Para verificar se isso realmente acontece, e considerando que especialistas dizem que está cada vez mais difícil diferenciar respostas humanas das geradas por IA, resolvemos fazer um experimento.

Participamos de uma entrevista inteira respondendo apenas com textos criados pelo ChatGPT, mas adaptados para soar o mais naturais possível: falamos com pausas, hesitações e até alguns vícios de linguagem, como qualquer pessoa faria.

O retorno do recrutador robótico foi bastante positivo, apesar da “trapaça”.

“É evidente que você possui uma sólida compreensão do processo de apuração de notícias e transmite uma abordagem cuidadosa e ética ao lidar com informações contraditórias, o que é crucial em sua área”, dizia a mensagem. A nota final, em uma escala de 0 a 10, foi 7.

Descobrimos depois, no entanto, que o sistema havia registrado um alerta sobre esse candidato para o entrevistador sobre uma “provável leitura”, ou seja, que talvez esse candidato estivesse lendo as respostas ao invés de responder por conta própria.

Crédito, Reprodução/DigAI

‘Algoritmo não pode discriminar; se acontecer, candidato pode buscar indenização contra empresa’

Empresas que queiram recrutar candidatos com uso da IA devem adotar uma série de cuidados para evitar problemas legais, explica o advogado Rafael Bispo de Filippis, sócio do escritório Mattos Filho.

Embora ainda não exista uma legislação sobre o tema no Brasil, continuam valendo as regulamentações que impedem discriminação nesses processos.

“O algoritmo não pode ter viés discriminatório. Se isso acontecer, o candidato pode buscar indenização contra a empresa que está fazendo recrutamento”, diz.

Uma boa forma de evitar processos, diz o advogado, é já se adaptar ao texto do projeto de lei que regulamenta o uso de IA, aprovado no Senado no fim de 2024.

A proposta é descrita como tendo o objetivo de proteger direitos fundamentais e estimular a inovação responsável, “em benefício da pessoa humana, do regime democrático e do desenvolvimento social, científico, tecnológico e econômico.”

Ela estabelece uma série de direitos, como o direito à informação sobre interações com sistemas de IA, privacidade e proteção de dados pessoais, não discriminação e correção de vieses discriminatórios.

Para virar lei, o projeto ainda precisa ser aprovado na Câmara.

“É um PL que fomenta a questão da não discriminação e da transparência. O candidato tem que ser informado de que aquele processo de recrutamento ou parte dele vai ser feito com IA. Tem também que poder acessar mais detalhes de como vai funcionar essa utilização da tecnologia.”

Filippis destaca também que é importante que as empresas assinem um contrato com as provedoras do serviço de IA com previsão de reparação. “Se der um problema no recrutamento e o serviço se mostrar discriminatório, aquele candidato vai buscar indenização contra a empresa, não contra quem vendeu o software.”

Sugere também que é uma boa precaução que as empresas armazenem gravações das entrevistas feitas por IA e que treinem seus profissionais de RH.

Mas e os candidatos, como vão conseguir provar que foram discriminados?

“É um tipo de disputa judicial em que é difícil para o candidato provar que houve discriminação. Por outro lado, se a empresa não tem mecanismos de transparência, ela sofre nesse tipo de briga”, diz ele. “Não duvidaria que a Justiça do Trabalho caminhe, no futuro, em um posicionamento de que cabe à empresa provar que não houve discriminação.”

O advogado explica também que os candidatos podem solicitar, pela via judicial, acesso aos dados de sua entrevista e avaliação, com base na Lei Geral de Proteção de Dados (LGPD).

“Embora seja difícil provar a discriminação, a depender do tipo de pergunta, pode provar um indício discriminatório. Um exemplo clássico, de antes da IA, é a pergunta sobre se uma candidata mulher pretende ter filhos.”

Fonte.:BBC NEWS BRASIL