Crédito, Alex Wong/Getty Images

- Author, Zoe Kleinman

- Role, Editora de tecnologia

- X, @zsk

Mark Zuckerberg teria começado a trabalhar no Koolau Ranch, seu extenso complexo de 1.400 acres (cerca de 5 quilômetros quadrados) na ilha havaiana de Kauai, já em 2014.

Está previsto que inclua um abrigo, com os seus próprios suprimentos de energia e alimentos, embora os carpinteiros e eletricistas que trabalham no local tenham sido proibidos de falar sobre isso por acordos de confidencialidade, de acordo com uma reportagem da revista Wired.

Um muro de quase dois metros bloqueava a visão do projeto a partir de uma estrada próxima.

Quando questionado no ano passado se estava construindo um abrigo para o fim do mundo, o fundador do Facebook respondeu com um “não” categórico. O espaço subterrâneo com cerca de 465 metros quadrados é, segundo ele, “apenas um pequeno abrigo, como um porão”.

Isso não impediu as especulações — da mesma forma que sua decisão de comprar 11 propriedades no bairro de Crescent Park, em Palo Alto, na Califórnia, aparentemente adicionando um espaço subterrâneo de 650 metros quadrados.

Crédito, Bloomberg via Getty Images

Embora suas licenças de construção se refiram a porões, de acordo com o New York Times, alguns de seus vizinhos chamam isso de bunker. Ou a “batcaverna” de um bilionário.

Há também especulações em torno de outros líderes do setor de tecnologia, alguns dos quais parecem ter estado ocupados a comprar terrenos com espaços subterrâneos, prontos para serem convertidos em bunkers de luxo avaliados em milhões de reais.

Reid Hoffman, cofundador do LinkedIn, falou sobre o “seguro contra o apocalipse”. Ele afirmou anteriormente que cerca de metade dos super-ricos possui esse tipo de seguro, sendo a Nova Zelândia um destino popular para a compra de imóveis.

Será que eles estão realmente se preparando para uma guerra, para os efeitos das mudanças climáticas ou para algum outro evento catastrófico que o resto de nós ainda não conhece?

Crédito, Getty Images

Nos últimos anos, o avanço da inteligência artificial (IA) só veio aumentar essa lista de potenciais problemas existenciais. Muitos estão profundamente preocupados com a rapidez dessa evolução.

Ilya Sutskever, cientista-chefe e cofundador da OpenAI, é considerado um deles.

Em meados de 2023, a empresa sediada em São Francisco lançou o ChatGPT — o chatbot agora utilizado por centenas de milhões de pessoas em todo o mundo — e estava trabalhando rapidamente em atualizações.

Mas, naquele verão, Sutskever estava cada vez mais convencido de que os cientistas da computação estavam prestes a desenvolver a inteligência artificial geral (AGI) — o ponto em que as máquinas igualam a inteligência humana —, de acordo com um livro da jornalista Karen Hao (veja a entrevista da BBC News Brasil com a autora).

Crédito, AFP via Getty Images

Em uma reunião, Sutskever sugeriu aos colegas que cavassem um abrigo subterrâneo para os principais cientistas da empresa antes que uma tecnologia tão poderosa fosse lançada ao mundo, relata Hao.

“Definitivamente, vamos construir um bunker antes de lançarmos a AGI”, ele teria dito, embora não esteja claro a quem ele se referia com “nós”.

Isso revela um fato curioso: muitos cientistas da computação e líderes tecnológicos renomados, alguns dos quais estão trabalhando arduamente para desenvolver uma forma extremamente inteligente de IA, também parecem profundamente receosos do que ela poderá vir a fazer no futuro.

Então, quando exatamente — se é que algum dia — a AGI chegará? E ela poderia realmente ser tão transformadora a ponto de assustar as pessoas comuns?

Crédito, Getty Images

Uma chegada mais cedo do que pensamos’

Os líderes tecnológicos afirmam que a AGI está chegando. O diretor da OpenAI, Sam Altman, afirmou em dezembro de 2024 que ela chegará “mais cedo do que a maioria das pessoas no mundo imagina”.

Demis Hassabis, cofundador da DeepMind, previu que isso ocorrerá nos próximos cinco a dez anos, enquanto o fundador da Anthropic, Dario Amodei, escreveu no ano passado que seu termo preferido — “IA poderosa” — poderá estar entre nós já em 2026.

Outros têm dúvidas. “Eles mudam as regras o tempo todo”, diz Dame Wendy Hall, professora de ciência da computação na Universidade de Southampton. “Depende de com quem você fala.” Falamos por telefone, mas quase consegui ouvir ela revirando os olhos.

“A comunidade científica afirma que a tecnologia de IA é incrível”, acrescenta ela, “mas está muito longe da inteligência humana”.

Primeiro, seria necessário haver uma série de “avanços fundamentais”, concorda Babak Hodjat, diretor de tecnologia da empresa de tecnologia Cognizant.

Além disso, é improvável que isso aconteça de uma só vez. Pelo contrário, a IA é uma tecnologia em rápido avanço, está em evolução e há muitas empresas em todo o mundo correndo para desenvolver suas próprias versões.

Mas uma das razões pelas quais a ideia entusiasma alguns no Vale do Silício é que ela é considerada um precursor de algo ainda mais avançado: a ASI, ou superinteligência artificial — uma tecnologia que supera a inteligência humana.

Foi em 1958 que o conceito de “singularidade” foi atribuído postumamente ao matemático húngaro John von Neumann. Ele se refere ao momento em que a inteligência computacional avança além da compreensão humana.

Crédito, Getty Images

Mais recentemente, o livro Genesis, de 2024, escrito por Eric Schmidt, Craig Mundy e o falecido Henry Kissinger, explora a ideia de uma tecnologia superpoderosa que se torna tão eficiente na tomada de decisões e na liderança que acabamos entregando-lhe o controle total.

É uma questão de quando, não se, argumentam.

Dinheiro para todos, sem precisar de um emprego?

Os defensores da AGI e da ASI são quase evangelistas em relação aos seus benefícios. Eles argumentam que ela encontrará novas curas para doenças mortais, resolverá as mudanças climáticas e inventará uma fonte inesgotável de energia limpa.

Elon Musk chegou a afirmar que a IA superinteligente poderia inaugurar uma era de “renda alta universal”.

Recentemente, ele endossou a ideia de que a IA se tornará tão barata e difundida que praticamente qualquer pessoa desejará ter seu “próprio R2-D2 e C-3PO pessoais” (referindo-se aos andróides de Star Wars).

“Todos terão os melhores cuidados médicos, alimentação, transporte doméstico e tudo o mais. Abundância sustentável”, afirmou com entusiasmo.

Crédito, AFP via Getty Images

É claro que há um lado assustador. Será que essa tecnologia poderia ser sequestrada por terroristas e usada como uma arma poderosa? E se ela decidir por conta própria que a humanidade é a causa dos problemas do mundo e nos destruir?

“Se for mais inteligente do que você, então temos que mantê-lo sob controle”, alertou Tim Berners Lee, criador da World Wide Web, em entrevista à BBC no início deste mês.

“Temos que ser capazes de desligá-la.”

Crédito, Getty Images

Os governos estão tomando algumas medidas de proteção. Nos Estados Unidos, onde muitas das principais empresas de IA estão sediadas, o presidente Biden aprovou uma ordem executiva em 2023 que exigia que algumas empresas compartilhassem os resultados dos testes de segurança com o governo federal — embora o presidente Trump tenha revogado parte da ordem, chamando-a de “barreira” à inovação.

Enquanto isso, no Reino Unido, o AI Safety Institute (Instituto de Segurança em Inteligência Artificial) — um órgão de pesquisa financiado pelo governo — foi criado há dois anos para compreender melhor os riscos apresentados pela inteligência artificial avançada.

E depois há os super-ricos com seus próprios planos de seguro contra o apocalipse.

“Dizer que você está ‘comprando uma casa na Nova Zelândia’ é como dar uma piscadela, sem dizer mais nada”, disse Reid Hoffman. O mesmo provavelmente se aplica aos bunkers.

Mas há uma falha distintamente humana.

Certa vez, conheci um ex-guarda-costas de um bilionário que tinha seu próprio “bunker” e me disse que a primeira prioridade de sua equipe de segurança, se isso realmente acontecesse, seria eliminar o chefe e entrar no bunker. E ele não parecia estar brincando.

É tudo alarmismo sem sentido?

Neil Lawrence é professor de aprendizado de máquina na Universidade de Cambridge. Para ele, todo esse debate em si é um absurdo.

“A noção de Inteligência Artificial Geral é tão absurda quanto a noção de um ‘Veículo Artificial Geral'”, argumenta ele.

“O veículo certo depende do contexto. Usei um Airbus A350 para voar até o Quênia, uso um carro para ir à universidade todos os dias, vou a pé até a cafeteria… Não existe nenhum veículo que possa fazer tudo isso.”

Para ele, falar sobre AGI é uma distração.

Crédito, Smith Collection/Gado/Getty Images

A tecnologia que desenvolvemos permite, pela primeira vez, que pessoas comuns conversem diretamente com uma máquina e, potencialmente, façam com que ela execute o que desejam. Isso é absolutamente extraordinário… e totalmente transformador.

A grande preocupação é que estamos tão envolvidos nas narrativas das grandes empresas de tecnologia sobre a IGA que estamos perdendo de vista as maneiras pelas quais precisamos melhorar as coisas para as pessoas.

As ferramentas atuais de IA são treinadas com montanhas de dados e são boas em identificar padrões: sejam sinais de tumores em exames ou a palavra mais provável de aparecer após outra em uma sequência específica. Mas elas não “sentem”, por mais convincentes que suas respostas possam parecer.

“Existem algumas maneiras ‘enganosas’ de fazer com que um Grande Modelo de Linguagem (a base dos chatbots de IA) aja como se tivesse memória e aprendesse, mas elas são insatisfatórias e bastante inferiores às dos seres humanos”, afirma Hodjat.

Crédito, Getty Images

Vince Lynch, CEO da IV.AI, com sede na Califórnia, também é cauteloso em relação a declarações exageradas sobre a AGI.

“É um ótimo marketing”, diz ele. “Se você é a empresa que está construindo a coisa mais inteligente que já existiu, as pessoas vão querer lhe dar dinheiro.”

Ele acrescenta: “Não é algo que vai acontecer daqui a dois anos. Requer muito processamento, muita criatividade humana, muita tentativa e erro”.

Quando questionado se acredita que a AGI algum dia se tornará realidade, há uma longa pausa.

Inteligência sem consciência

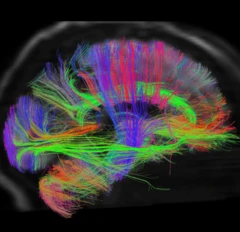

De certa forma, a IA já superou o cérebro humano. Uma ferramenta de IA generativa pode ser especialista em história medieval em um minuto e resolver equações matemáticas complexas no minuto seguinte.

Algumas empresas de tecnologia afirmam que nem sempre sabem por que seus produtos respondem da maneira que respondem. A Meta diz que há alguns sinais de que seus sistemas de IA estão se aprimorando.

No entanto, em última análise, por mais inteligentes que as máquinas se tornem, biologicamente, o cérebro humano ainda leva vantagem.

Tem cerca de 86 bilhões de neurônios e 600 trilhões de sinapses, muito mais do que os equivalentes artificiais. O cérebro não precisa fazer pausas entre as interações e está constantemente se adaptando a novas informações.

“Se você disser a um ser humano que foi encontrada vida em um exoplaneta, ele aprenderá isso imediatamente e isso afetará sua visão de mundo daqui para frente. Para um LLM (Large Language Model, ou Modelo de Linguagem Grande), ele só saberá disso enquanto você continuar repetindo isso como um fato”, diz Hodjat.

Os LLMs também não possuem metacognição, o que significa que eles não sabem exatamente o que sabem. Os seres humanos parecem ter uma capacidade introspectiva, às vezes chamada de consciência, que lhes permite saber o que sabem.

É uma parte fundamental da inteligência humana — e que ainda não foi reproduzida em laboratório.

Fonte.:BBC NEWS BRASIL